“L’intelligenza artificiale sarà l’ultima invenzione realizzata dall’umanità.”

— Nick Bostrom

L’incontro tra intelligenza artificiale (IA) e il settore legale sta ridefinendo le modalità con cui avvocati, giudici e professionisti sanitari gestiscono complessi casi di negligenza medica. L’IA promette efficienza, accuratezza e maggiore equità, automatizzando analisi che richiederebbero settimane di lavoro umano. Tuttavia, questa rivoluzione tecnologica solleva domande cruciali relative a etica, privacy e responsabilità legale, che devono essere affrontate con attenzione.

Naidu, G. and Krishnan, V. (2025) Artificial Intelligence-Powered Legal Document Processing for Medical Negligence Cases: A Critical Review. International Journal of Intelligence Science, 15, 10-55. doi: 10.4236/ijis.2025.151002.

Efficienza e accuratezza nella revisione documentale

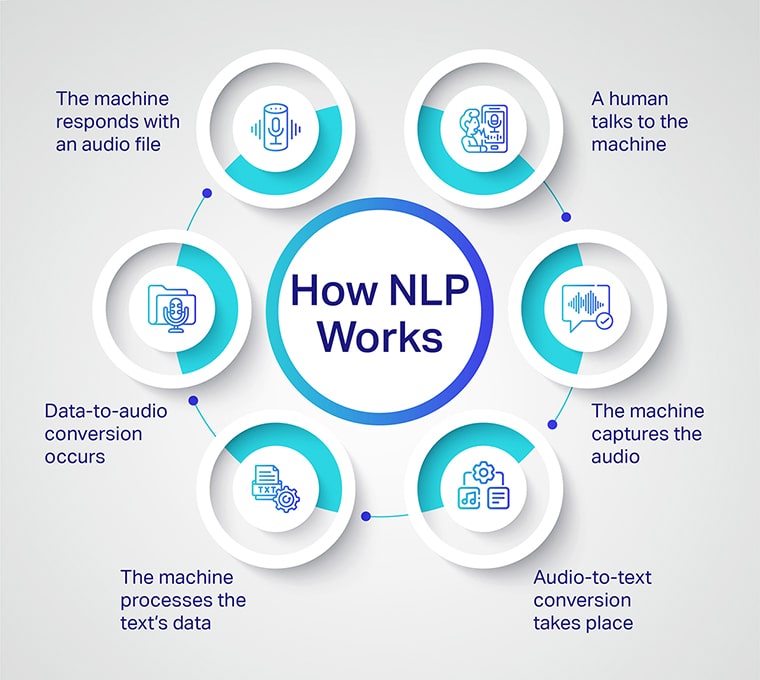

L’applicazione dell’IA alla revisione dei documenti legali nei casi di negligenza medica consente un drastico aumento della velocità e dell’affidabilità. Studi recenti evidenziano come sistemi basati su tecniche di machine learning e Natural Language Processing (NLP) possano ridurre fino al 60% il tempo richiesto per analizzare e classificare cartelle cliniche e testimonianze esperte. Questo aumento dell’efficienza permette agli avvocati di concentrarsi sugli aspetti strategici della causa, riducendo significativamente gli errori dovuti alla fatica o alla disattenzione umana.

Implicazioni etiche e privacy dei pazienti

L’utilizzo di dati sensibili come cartelle cliniche e testimonianze personali solleva importanti questioni etiche e di privacy. La capacità dell’IA di processare enormi quantità di dati personali pone rischi significativi per la riservatezza dei pazienti. Nonostante esistano normative come GDPR (EU) e HIPAA (USA), la velocità dello sviluppo tecnologico supera spesso quella delle regolamentazioni, rendendo essenziale una continua evoluzione del quadro normativo e un’attenzione costante alle implicazioni etiche.

Bias e trasparenza degli algoritmi

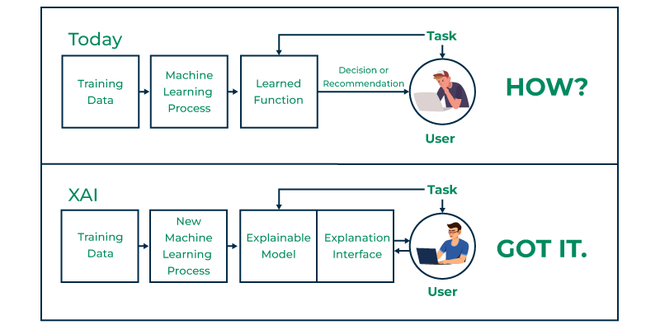

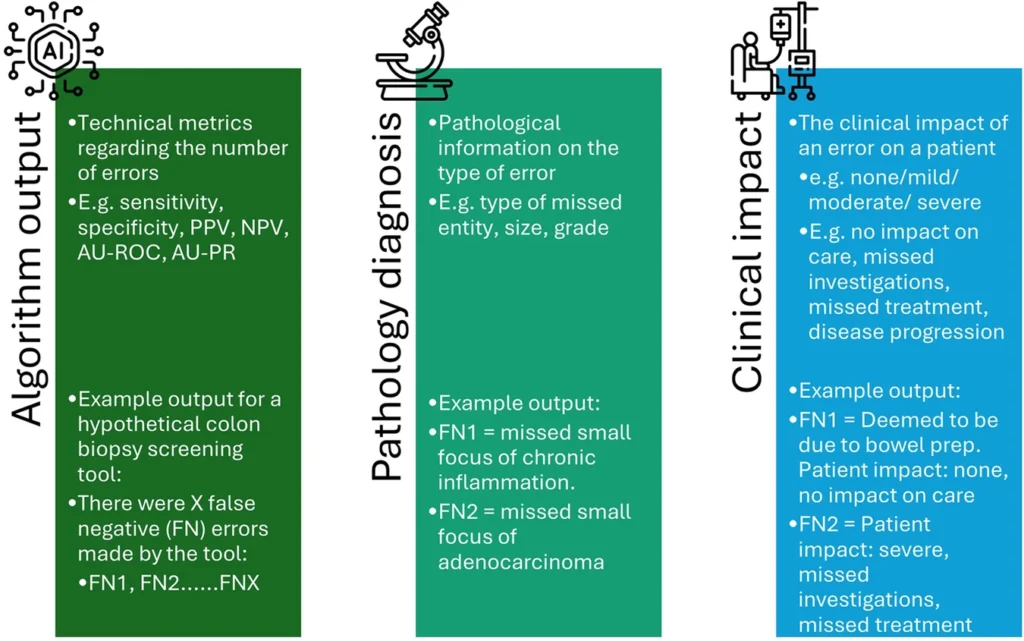

Una delle problematiche principali riscontrate nell’implementazione dell’IA è il rischio di bias algoritmico, ovvero di pregiudizi intrinseci derivanti dai dati utilizzati per l’addestramento degli algoritmi. Tali bias possono influenzare negativamente i risultati dei processi legali, colpendo in modo particolare le minoranze o gruppi sociali già vulnerabili. È cruciale, pertanto, sviluppare algoritmi equi e trasparenti, accompagnati da metodologie di spiegabilità (XAI), che possano rendere chiaro il processo decisionale dell’IA ai professionisti coinvolti.

Sfide di integrazione nei sistemi legali attuali

Nonostante i benefici evidenti, l’integrazione dell’IA nei flussi di lavoro legali preesistenti incontra resistenze culturali e operative. Molti studi mostrano che, soprattutto tra avvocati e giudici più anziani, vi è un certo scetticismo verso la tecnologia. La formazione adeguata e la gestione del cambiamento diventano dunque essenziali per garantire che l’adozione dell’IA sia non solo efficace, ma anche accettata dai professionisti del settore.

Questioni di responsabilità e giustizia

L’introduzione dell’IA solleva interrogativi sul tema della responsabilità legale in caso di errori algoritmici. Le domande sulla titolarità delle decisioni prese dall’IA e sulla responsabilità in caso di errore rimangono ancora aperte e richiedono un aggiornamento delle normative vigenti. È indispensabile un chiaro quadro legale che definisca responsabilità e obblighi di controllo per evitare che l’uso dell’IA porti a ingiustizie o situazioni di responsabilità non ben definite.

In conclusione…

L’intelligenza artificiale rappresenta un’importante opportunità per migliorare il sistema legale relativo ai casi di negligenza medica, grazie alla sua capacità di aumentare efficienza, accuratezza e imparzialità. Tuttavia, le sfide da affrontare, in particolare quelle legate a bias algoritmico, trasparenza, privacy e responsabilità, sono significative e richiedono l’attenzione congiunta di tecnici, esperti legali, eticisti e policy maker. Solo attraverso una collaborazione multidisciplinare sarà possibile sfruttare appieno le potenzialità dell’IA in questo delicato e cruciale ambito della giustizia.